Zu Beginn ein Fremdwort: «Anthropomorphisieren»; die Neigung, nicht-menschlichen Dingen menschliche Eigenschaften zuzuschreiben. Kaum malen wir einem Stein Augen auf, glauben wir schon, er habe Gefühle oder ein Bewusstsein.

Das geschieht auch bei künstlicher Intelligenz – und beginnt bereits mit ihrem Namen. Obwohl es keine allgemein gültige Definition davon gibt, was künstliche Intelligenz bedeutet, suggeriert das Wort «Intelligenz» eine Verwandtschaft zum menschlichen Denken.

Das sei ein Missverständnis, sagt der Technik-Philosoph Walther Ch. Zimmerli: «Wörtlich übersetzt heisst ‹Artificial› in diesem Zusammenhang ‹technisch› und ‹Intelligence› steht für ‹Informationsverarbeitung›. Das hat mit der Intelligenz des Menschen relativ wenig zu tun.»

KIs mit menschlichen Stimmen

Schon als der Begriff «künstliche Intelligenz» Mitte der 50er-Jahre geprägt wurde, gab es Kritik. In diesem Zusammenhang von «Intelligenz» zu sprechen, sei irreführend. Dass sich der Begriff trotzdem durchsetzen konnte, hat für Walther Ch. Zimmerli vor allem einen Grund: «Er berührt die tief sitzende mythische Vorstellung einer denkenden Maschine.»

Künstliche Intelligenz ist ein Begriff, der unheimlich fruchtbar ist und unheimlich ökonomisch ertragreich gemacht werden kann.

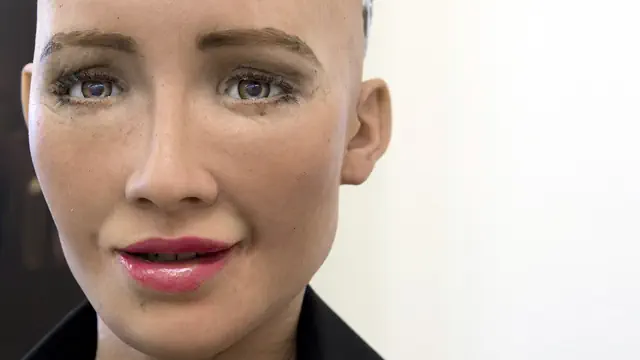

KI-Unternehmen haben wenig Interesse, diesen Mythos aufzugeben. Denn die damit geweckten Hoffnungen helfen beim Sammeln von Investorengeldern. Und das Anthropomorphisieren der Technologie zahlt sich noch aus anderen Gründen aus: Menschlich wirkende KI wird schneller akzeptiert, sorgt für mehr Zufriedenheit und eine längere Nutzungsdauer.

Das gilt insbesondere für die sogenannten grossen Sprachmodelle: KI-Chatbots wie ChatGPT. Mit ihnen kommunizieren wir, als wären sie Menschen. Und die Modelle formulieren ihre Antwort wiederum so, als ob sie ein Mensch wären. Sie antworten in Ich-Form und werden auch mit menschlichen Stimmen ausgestattet.

EU fordert Transparenz

Das Problem an der Vermenschlichung: Sie sorgt für Vertrauen, wo oft keines angebracht ist. Denn ein grosses Sprachmodell «denkt» nicht wie ein Mensch. Die KI hat dank einer enormen Menge von Trainingsdaten nur gelernt, wie menschliche Sprache funktioniert. Ihre Antworten spiegeln wider, was aufgrund des Gelernten statistisch am wahrscheinlichsten ist.

Ein Bewusstsein für wahr oder falsch hat die KI aber nicht. Deshalb kann sie mit grosser Autorität auch fehlerhafte Antworten geben. Nicht zuletzt aus diesem Grund schreibt die 2024 in Kraft getretene «Verordnung über künstliche Intelligenz» der EU vor, dass Nutzerinnen und Nutzer stets darüber informiert werden müssen, wenn sie es mit KI-Systemen zu tun haben.

Aufklären statt Ändern

Der Technik-Philosoph Walther Ch. Zimmerli bezweifelt, dass wir uns bald vom Begriff «künstliche Intelligenz» verabschieden werden. «Künstliche Intelligenz ist ein Begriff, der unheimlich fruchtbar ist und unheimlich ökonomisch ertragreich gemacht werden kann.» Aus der Geschichte vom Umgang des Menschen mit Kulturtechniken könne man lernen, dass sich Begriffe, die auf tief verwurzelten Archetypen basieren, nicht einfach ändern liessen, so Zimmerli.

Der Rat des Philosophen: Statt nach einer Alternative zu suchen, sollte besser darüber aufgeklärt werden, warum der Ausdruck «künstliche Intelligenz» irreführend ist. Und, lässt sich ergänzen: Stets sollten wir uns bewusst sein, dass wir es bei der künstlichen Intelligenz nicht mit einer Intelligenz zu tun haben, wie wir Menschen sie besitzen.